Split-test er spændende, sjov og kan være en ægte gamechanger. Det er mange gode grunde til at split-teste, hvis mængden af trafik tillader dit website. Men det er ikke det, det skal handle om her. Det skal handle om ikke at snyde sig selv når man split-tester. For hvad gør du når testen er moden til, at du skal til at konkludere på resultatet?

Hvis du kun kigger på det samlede resultat af din split-test, så er der stor chance for at du snyder dig selv. For der kan gemme sig negative resultater for de enkelte enhedstyper i dine testdata - især i forskellen mellem mobil og desktop trafik. Det kan gå hen og blive grunden til, at split-testens resultat aldrig kommer til udtryk i virkelighedens data.

Lad mig sige det ligeud: Det er supervigtigt at segmentere sine split-testdata. Hvis din split-test giver et endeligt løft på + 10% kan der let gemme sig et negativt resultat på minus 20% på mobilen og plus 30% på desktop i det samlede tal (det er bare eksempel-matematik her.

Min erfaring siger, at der altid er forskel på resultatet for desktop og for mobil. Hvilket for øvrigt giver fin mening, for det er jo to ret forskellige brugsoplevelser. Plus at det minder os om at det giver mindre og mindre mening at fastholde 1 fælles oplevelse.

Her får du et vildt eksempel på hvor stor forskel der kan være på resultatet for desktop og mobil i en split-test.

Denne test tog totalt fusen på mig. Så meget, at jeg stadig har svært ved at tro på resultatet. Desværre har jeg ikke fundet en grund til at lade være. Lad mig dele den for at vise hvor forskelligt adfærd de samme ændringer kan med føre på henholdsvis desktop og mobil.

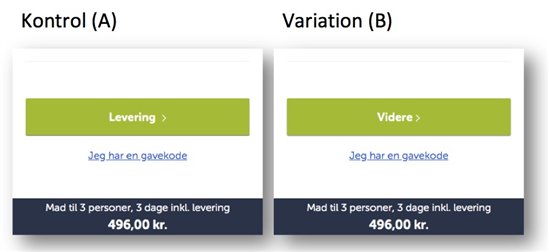

En kort introduktion. Det er en test for en virksomhed der sælger måltidskasser og testen foregik deres bestillingsflow. I testen ændrede vi navnet på knappen når man går fra et trin til det næste. Her i den mobile version:

I kontrollen stod der ”Levering” og i variationen stod der nu ”Videre”.

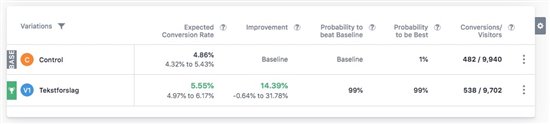

Her er et det overordnede resultat i VWO:

Testen har givet et fint løft på næsten 15% - så det er jo bare at implementere over hele linjen ikke? Nix. Lad mig vise dog hvorfor ikke.

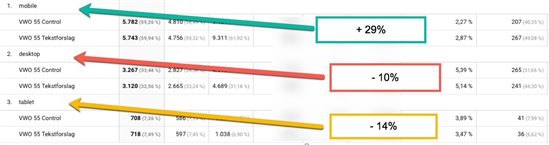

Sådan ser data ud i Google Analytics:

Bemærk at der på mobil er en stigning på 29%. Lad mig understrege at det er fuldstændig umuligt at forudsige den type adfærdsændring og et bemærkelsesværdigt resultat ved så lille en ændring. Jeg håber du forstår hvorfor vi var overraskede. Vi kan dokumentere, at vi på varianten har fået næsten 30% flere konverteringer i testperioden.

Men hov, hvad med desktop. Der er et fald på 10%. På tablet er der også et lille fald og op mod det mobile løft, giver det altså et samlet løft på 15% (Beregningerne varierer fra VWO til GO, det er princippet der er det vigtige).

Ok, lad mig huske at være djævlens advokat: Kan du ikke bare være ligeglad og implementere det samlede resultat, hvis det samlet ser går i plus? Det er flere grunde til, at jeg synes det er en dårlig idé. I første omgang virker det bare som dårlig købmandsskab at implementere noget der giver dårligere salg. Som konsulent er det da slet ikke noget jeg vil anbefale mine kunder.

Med andre ord, hvordan skal jeg stå på mål for at implementere et design der giver et fald på desktop på 15% ?

Der er ingen grund til at gennemtvinge de samme ændringer på desktop og mobil, den tid er ovre. De to enhedstyper skal håndteres forskelligt når de optimeres (ellers kan vi sgu heller ikke kalde det optimering). Samtidigt så kan konsekvenserne også blive større end man kan forudsige. Fx har mange websites efterhånden mere og stigende mobil trafik. Så det tab du får, kan ikke forudsiges, fordi trafikken, adfærden og konverteringsraten er så anderledes på mobil.

Eksempel: Jeg har for nyligt ekspertvurderet en wepshob der sælger vin. Ejerne fortale at deres brugere sjældent køber på mobilen. Så at tage et ”win” på mobilen og æde et tab på desktop ville jo være tåbeligt.

I stedet skal vi lære af det mobile resultat og udnytte det til netop at differentiere de to løsninger.

Men lad mig vende tilbage til segmenteringen. Det kan være en blandet fornøjelse at segmentere sine split-test data. Du skal nok forberede dig på lidt manuelt arbejde, men da det både er interessant og nødvendigt, så går det nok.

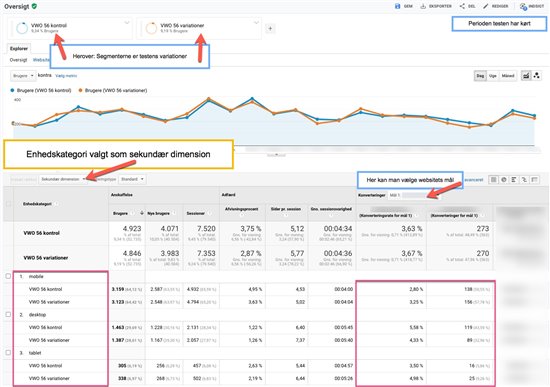

De fleste mindre virksomheder bruger Google Optimize (jeg kalder det herefter GO) eller Visual Website Optimizer (VWO i folkemunde). For GO er der den fordel at data allerede er koblet sammen med Google Analytics, hvor data kan segmenteres. For VWO gælder det, at du kan segmentere data direkte i værktøjet, men det kræver deres premium abonnement og det er de færreste der (forståeligt nok) vil betale for det. Det er også lige meget, for data kan relativt let sendes videre til Google Analytics. Det kan gøres på flere måder, men det mest ”moderne” er at gøre det via Google Tag Manager. Og skal det være ekstra tjekket, kan det sættes op så alle testdata automatisk sendes videre via GTM, så det ikke skal sættes op ved hver test (hvilket ellers er lidt manuelt og bøvlet i GTM).

Så ser det sådan ud (data i GA via GTM).

I første hug er der flere ting du kan gøre:

- Du kan tjekke at data ser nogenlunde ens ud i VWO og GA (det er altid godt at sikre sig).

- Du kan se på om data er signifikante – fordi selvom de er det for det samlede resultat, så er det ikke sikkert de er det pr. enhedstype og så skal din test køre længere tid.

- Har du data nok kan du endda segmentere yderligere, fx se på resultatet for mobile besøgende på sociale medier eller på betalt trafik (men er konverteringen på fx salg i en webshop, skal du have ret mange salg før de data er statistisk signifikante).

- Har du værdi på konverteringerne i Google, så kan du jo også sammenligne hvad resultaterne betyder i kroner og ører og det kan også gå hen og blive interessant – der kan fx være forskel på ordrernes størrelser ift til den samlede ændring i omsætning.

Hvis du vil beregne om data er gyldige – dvs om det statistisk set holder vand – så kan du bruge det her værktøj: abtestguide.com

Her kan du indtaste antal besøg og antal konverteringer og aflæse om dit segmenterede testresultat er statistisk gyldigt – altså om det kan statistisk set gælder for alle fremtidige besøgende og ikke de der aktuelt var med i testen.

Det kan være en kedelig øvelse af gå de segmenterede tal efter, for ofte sker resultatet ikke er signifikant og så står du over for en irriterende overvejelse: Skal jeg ignorere statistikken og implementere alligevel, eller skal jeg holde fast på det principielle og køre testen i længere tid. Hvis du blæser på statistikken, så er der nogle der vil mene at du skyder dig selv i foden, fordi du rent faktisk ikke kender testen egentlige resultat. Har du fx så et lille løft, kan det vise så i virkeligheden af være et lille fald.

Jeg håber du kan se problemet og fra nu af vil gå efter at segmentere dine split-test resultater – og at du vil huske på denne udfordring når du læser andres resultater. Er de ikke segmenterede så er du i din bedste ret til at udfordre hvad man egentligt kan lære af den test.

Lad mig høre om dine erfaringer med at segmentering af split-test herunder. Har du gode tips og tricks til os andre, så lad os få dem med også ![]()

Bliv gratis medlem

Bliv gratis medlem